2026年4月10日 星期四 发布于「AI技术前沿」

一、开篇:为什么AI宠物助手是当下必学的技术方向?

2026年,全球AI陪伴市场持续升温,各类宠物用AI工具和智能硬件层出不穷。从能读懂狗情绪的AI Agent到多模态交互的虚拟宠物,从零售级开源项目到百万用户量级的商业产品,AI宠物助手已成为检验大模型落地能力的重要场景之一-25-6。

许多开发者在学习和面试中面临共同的困惑:看过RAG(Retrieval-Augmented Generation,检索增强生成)的概念,却不知道如何落地到具体场景;知道LLM(Large Language Model,大语言模型)能对话,但不理解Agent如何与外部知识库交互;面试被问到“宠物健康助手的技术选型”,答不上核心架构。

本文从技术科普出发,结合原理讲解与代码示例,系统梳理AI宠物助手的核心概念与实现路径,帮助读者建立完整知识链路。

二、痛点切入:传统“养宠管理”为什么需要AI?

在AI宠物助手出现之前,宠物主人的日常管理依赖一套“碎片化系统”:兽医发邮件提醒、美容师发短信、狗粮订阅藏在某个不常看的App里,伴侣之间靠共享日历协调——但谁都可能忘记更新。有开发者在博客中算过一笔账:一只宠物每年涉及12类以上的日程节点,分散在6个不同渠道-25。

从技术角度看,传统实现方式存在三大痛点:

① 信息孤岛严重。宠物健康记录、疫苗接种、行为观察等数据分散在不同系统和文档中,缺乏统一查询入口。有用户在宠物医院就诊时,医生甚至在后台找了半天也没找到宠物的电子病历-11。

② 通用大模型无法处理私有数据。问一个通用LLM“我家猫叫什么名字”,它无法回答,因为训练数据中没有这个信息-11。宠物相关的专业知识和私有数据,大模型天然不具备。

③ 缺乏领域感知。市面上的宠物App大致分三类:社交类让你晒狗、健康类让你手动填数据、电商类让你买东西——没有一类真正理解“我的狗是个有需求的生命体”-25。

正是这些痛点,催生了基于LLM+RAG架构的AI宠物助手技术方案。

三、核心概念讲解:RAG(检索增强生成)

3.1 标准定义

RAG(Retrieval-Augmented Generation,检索增强生成) 是一种将信息检索与大语言模型生成能力相结合的AI技术框架。

3.2 关键词拆解

Retrieval(检索) :在生成答案前,先从外部知识库(如宠物医疗手册、用户私有档案)中最相关的信息。

Augmented(增强) :将检索到的信息作为“额外上下文”注入到LLM的提示词中。

Generation(生成) :LLM基于“原始问题 + 检索到的上下文”生成更精准、有据可依的回答-11。

3.3 生活化类比

想象一下:你是一个知识渊博但无法记住所有细节的宠物医生(这是LLM)。每次主人问诊,你不靠记忆硬答,而是先快速翻阅病案室里的相关病历(这是Retrieval),然后基于这些资料给出诊断(这是Generation)。这样既利用了你的专业推理能力,又避免了“记错”或“编造”的风险。

3.4 解决的问题

RAG有效解决了三大难题-11:

私有数据访问:模型无需重新训练即可“看到”企业内部的非公开数据。

知识时效性:可以随时更新知识库,无需等待模型重新训练。

幻觉(Hallucination)控制:生成的回答有据可查,可追溯信息来源。

四、关联概念讲解:Agent(智能体)

4.1 标准定义

Agent(智能体) 是一种能够感知环境、自主决策并执行行动的AI系统。它通常具备记忆能力、工具调用能力和多步推理能力。

4.2 RAG与Agent的关系

RAG和Agent不是替代关系,而是“能力组件”与“系统架构”的关系:

| 维度 | RAG | Agent |

|---|---|---|

| 核心作用 | 检索外部知识增强回答质量 | 感知环境、决策规划、执行行动 |

| 输入输出 | 单轮问答:问题→检索→生成 | 多轮交互:目标→规划→行动→反馈 |

| 典型场景 | 客服问答、知识库查询 | 自动化任务、多步规划、工具调用 |

| 两者关系 | Agent可以“调用”RAG作为其知识获取能力之一 |

一句话概括:RAG解决的是“AI懂什么”,Agent解决的是“AI能做什么”。一个完整的AI宠物助手通常同时具备两者——用RAG获取专业知识,用Agent规划执行养宠相关任务。

4.3 运行机制示例

以“Dog Agent”开源项目为例-25,其初始化加载三个核心模块:

TemporalMemory(时间感知上下文) :理解时间维度上的事件关系

PetOwnershipRealm(领域知识库) :内置养宠世界的知识框架

CarePlanner(护理规划器) :根据意图生成行动方案

用户输入“下午3点带狗看兽医”后,系统不是简单弹个提醒,而是提前一晚提醒准备疫苗记录、查好路况建议出发时间,甚至附带一句“记得带他的安抚玩具”——因为系统记录了这只狗晕车焦虑的历史-25。

五、概念关系总结

RAG与Agent的逻辑关系可概括为:

RAG是增强型知识获取手段,Agent是多能力协同的系统架构。RAG为Agent注入“专业知识”,Agent为RAG赋予“行动能力”。

在一个典型的AI宠物助手中,两者协同工作:用户问题先由Agent进行意图解析,判断是需要知识查询(调用RAG)还是执行操作(如设置提醒、更新状态),然后执行相应动作并反馈结果。

六、代码示例:基于RAG的宠物健康助手核心实现

下面展示一个基于Python的简化版RAG宠物健康助手核心逻辑,使用OpenAI API和向量检索-35:

import openai import base64 import json from sentence_transformers import SentenceTransformer import faiss 1. 知识库构建(使用宠物医疗手册PDF向量化) model = SentenceTransformer('all-MiniLM-L6-v2') 假设已提取宠物症状-诊断知识文本块 knowledge_chunks = [ "猫呕吐可能是毛球症、消化不良或更严重的疾病。", "狗狗持续咳嗽超过3天,建议就医排查呼吸道感染。", ... 更多知识块 ] 生成向量并存入FAISS索引 chunk_embeddings = model.encode(knowledge_chunks) index = faiss.IndexFlatL2(chunk_embeddings.shape[1]) index.add(chunk_embeddings) def retrieve_relevant_context(query: str, top_k=3) -> str: """检索最相关的知识片段""" query_embedding = model.encode([query]) distances, indices = index.search(query_embedding, top_k) return "\n".join([knowledge_chunks[i] for i in indices[0]]) def pet_health_assistant(user_query: str) -> str: """宠物健康助手主函数""" Step 1: 检索相关专业知识 relevant_context = retrieve_relevant_context(user_query) Step 2: 构造增强提示词 prompt = f""" 你是一位专业的宠物健康助手。请基于以下参考信息回答用户的问题。 如果参考信息中没有明确答案,请如实告知并建议咨询兽医。 【参考信息】 {relevant_context} 【用户问题】 {user_query} 【要求】 - 回答专业、准确、有依据 - 如果症状严重,明确标注“建议立即就医” - 用宠物主人易懂的语言 """ Step 3: LLM生成回答 client = openai.OpenAI() response = client.chat.completions.create( model="gpt-4", messages=[{"role": "user", "content": prompt}], temperature=0.3 ) return response.choices[0].message.content 示例调用 print(pet_health_assistant("我的猫最近一直呕吐,不太吃东西"))

代码关键点说明:

第1-12行:知识库构建与向量化,将专业宠物医疗知识转为可检索的向量索引

第14-18行:

retrieve_relevant_context函数实现语义检索,而非简单关键词匹配第20-37行:主函数遵循“检索→增强→生成”三阶段RAG流程

第32-34行:提示词工程要求模型标注紧急程度,这是宠物医疗场景的关键设计

七、底层原理支撑

AI宠物助手的技术实现依赖以下几个底层基础:

向量化与语义检索(Embedding & Semantic Search) :将文本转换为高维向量,通过向量相似度计算实现语义层面的信息匹配,而非传统的关键词匹配。

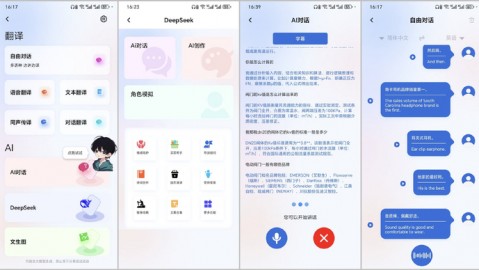

大语言模型推理(LLM Inference) :以Transformer架构为基础,通过注意力机制理解上下文语义并生成自然语言回复。在实际应用中,GPT-4o、Gemini、Claude、通义千问、DeepSeek等都是常见选择。

记忆机制(Memory Mechanism) :Agent需要维护短期记忆(对话上下文)和长期记忆(宠物档案、历史行为)。长期记忆通常采用向量数据库存储,通过RAG机制检索调用-12。

多模态感知(Multimodal Perception) :高端AI宠物产品集成了视觉识别、语音交互、触觉传感等多模态能力。例如,通过分析宠物的叫声、表情和行为,对宠物心理状态进行估计-47;通过触摸与重力感应,用摇动的尾巴和LED眼神传递情绪-6。

端云协同架构(Edge-Cloud Collaboration) :端侧部署轻量级AI推理引擎实现本地快速响应(如行为异常检测),云端部署大模型处理复杂推理和知识检索-21。

八、高频面试题与参考答案

Q1:请解释RAG的工作原理,以及在AI宠物健康助手中如何应用?

标准答案要点:

RAG分为三个阶段:①检索(Retrieval)——将用户查询向量化,从外部知识库中召回最相关的文档片段;②增强(Augmentation)——将检索到的片段与原始问题拼接为增强提示;③生成(Generation)——LLM基于增强提示生成回答。在宠物健康助手中,知识库可存放兽医指南、宠物疾病库等专业资料,让LLM在有据可依的前提下给出精准诊断建议,避免“幻觉”。

Q2:Agent与RAG的区别是什么?如何协同工作?

标准答案要点:

RAG是一种知识增强技术,解决“模型不知道的怎么回答”;Agent是一种自主决策架构,解决“模型怎么规划和执行”。两者可以协同:Agent在理解用户意图后,如果需要专业知识就调用RAG模块检索,如果需要执行操作(如设置提醒、更新日历)就调用工具API。完整的AI宠物助手通常是一个具备RAG能力的Agent。

Q3:在宠物健康场景中,如何评估RAG系统的回答质量?

标准答案要点:

可从四个维度评估:①事实准确性——回答是否有兽医资料支撑,与金标准对比;②幻觉率——模型编造不存在信息的比例;③可追溯性——每个回答能否定位到知识库中的原文片段;④实用性——给出的建议在真实场景中是否可操作、是否标注了紧急程度。

Q4:选择LLM作为宠物助手基座时,有哪些关键考量?

标准答案要点:

①推理成本与延迟——实时交互场景对响应速度敏感,需平衡模型大小与性能;②多模态能力——是否需要识别宠物照片/视频;③上下文窗口长度——能否支撑长期记忆和复杂对话历史;④本地化部署可行性——对数据隐私要求高的场景需支持私有化部署(如Ollama + LlamaIndex方案)-。

九、总结

本文围绕AI宠物助手这一大模型落地的重要场景,系统梳理了以下核心内容:

| 知识点 | 核心要点 |

|---|---|

| 痛点 | 信息孤岛 + 大模型无私有数据 + 缺乏领域感知 |

| RAG | 检索→增强→生成,解决知识缺乏与幻觉问题 |

| Agent | 感知→规划→行动,赋予AI自主执行能力 |

| 关系 | RAG是知识手段,Agent是系统架构 |

| 底层 | 向量检索、LLM推理、记忆机制、多模态、端云协同 |

| 考点 | RAG原理、Agent与RAG协同、质量评估、模型选型 |

易错点提醒:不要将RAG简单理解为“在Prompt里塞一段文档”——高质量的RAG涉及文档切片策略、向量模型选择、检索排序优化等多个技术环节;也不要将Agent等同于RAG——前者是系统架构层面的设计,后者是能力组件。

预告:下一篇将深入剖析AI Agent的四大核心组件(记忆、规划、工具调用、反思),并给出基于LangGraph的多Agent协作宠物护理系统实现示例,敬请期待。

📌 本文收录于「AI技术架构实战」系列,欢迎持续关注。数据截至2026年4月,基于行业公开资料与开源项目整理。