(发布时间:北京时间2026年4月10日)

一、开篇引入

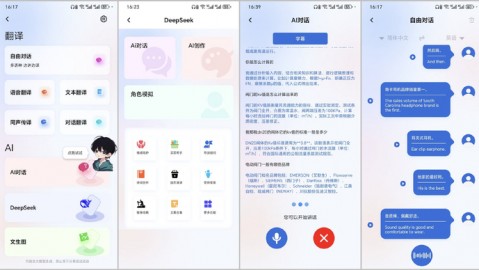

在全球化深入发展的今天,AI助手翻译功能已成为跨越语言壁垒的核心基础设施。多数开发者在实际工作中“只会调用API、不懂底层原理”,导致遇到翻译质量问题无从排查、面试时概念混淆答不出要点。本文将从传统机器翻译的痛点出发,系统讲解大语言模型翻译(LLM-based Translation) 的核心原理,涵盖Transformer架构、自注意力机制、与传统NMT的对比、代码示例及高频面试考点,帮助读者建立起完整的技术认知链路。

二、痛点切入:传统机器翻译的困境

我们先来看一个传统神经机器翻译(NMT)的基础示例:

传统NMT模型调用示例(简化) from transformers import MarianMTModel, MarianTokenizer model_name = 'Helsinki-NLP/opus-mt-en-zh' tokenizer = MarianTokenizer.from_pretrained(model_name) model = MarianMTModel.from_pretrained(model_name) text = "This movie is a blast!" inputs = tokenizer(text, return_tensors="pt", padding=True) translated = model.generate(inputs) result = tokenizer.decode(translated[0], skip_special_tokens=True) print(result) 输出:“这部电影是爆炸”

这段代码输出的结果显然与原文含义相去甚远。问题出在哪里?

传统NMT存在三大核心缺陷:

缺乏上下文理解:模型将“blast”直译为“爆炸”,无法识别其在电影评论语境中的比喻义

输出风格单一:无论面向学术评审还是普通观众,译文千篇一律

交互能力缺失:发现翻译错误后无法即时修正,只能依赖离线重训

这些缺陷导致传统翻译在实际场景中频繁出现“形似而神不似”的问题——专业术语识别错误率比人工高3倍,法律领域BLEU得分仅0.28-1。

三、核心概念讲解:大语言模型翻译(LLM Translation)

3.1 标准定义

大语言模型翻译(Large Language Model-based Translation,简称LLM Translation) 是指基于预训练大语言模型(如GPT-4、Gemini、Qwen等)实现的跨语言文本转换技术。与传统机器翻译不同,LLM Translation不依赖“编码器-解码器”的词级映射,而是通过在海量多语言语料上的预训练,让模型掌握跨语言的语法、语义甚至文化常识,从而动态适应不同翻译场景-3。

3.2 生活化类比

想象一下:传统翻译就像一本“英汉词典”——你查一个词,它给你一个标准对应词,但遇到“苹果公司发布新手机”这样的句子时,词典无法判断“apple”是指水果还是公司。

而AI助手的翻译功能则像一个“双语人类翻译”——他不仅会查词典,还能根据上下文理解你的意思,甚至能根据你的要求调整语气(正式/口语/学术),在你指出错误后即时修改译文。

3.3 核心价值

语义理解:从“词级映射”升级为“上下文驱动”。以“This movie is a blast!”为例,大模型能根据“movie”这一语境判断“blast”意为“极其有趣”,而非字面“爆炸”-3

灵活适配:用户可通过提示词一键调整译文风格,如“商务正式”“儿童易懂”或“学术风格”-8

交互迭代:用户可直接与模型对话实现即时重译,将翻译准确率从传统机器翻译的70%-75%提升至90%-95%-44

四、关联概念讲解:Transformer架构与自注意力机制

4.1 标准定义

Transformer架构:一种基于自注意力机制的神经网络架构,彻底取代了传统的循环神经网络(RNN),成为现代AI翻译的技术基石-。

自注意力机制(Self-Attention) :让模型在编码一个词时,能够“关注”句子中所有其他词,计算每个词与当前词的相关程度,从而动态捕捉全局语义依赖。

4.2 与LLM翻译的关系

Transformer是“基础设施”,LLM翻译是“上层应用”——没有Transformer架构提供的全局上下文建模能力,大语言模型的翻译能力无从谈起。通俗地说,Transformer好比高速公路,自注意力机制好比交通调度系统,LLM翻译则是在这条高速路上奔驰的“翻译专车”。

4.3 工作原理示例

当翻译句子“The cat sat on the mat because it was tired”时,自注意力机制需要判断“it”指代的是“cat”还是“mat”。模型通过计算“it”与句中每个词的注意力权重,发现“it”与“cat”的关联度最高(因为“tired”通常与生物而非物体关联),从而将“it”正确译为“它(指猫)”。这正是Transformer模型能够一次性处理整个句子、在完整语境中权衡词语关系的原因-6。

五、概念关系与区别总结

| 维度 | 传统NMT | LLM Translation |

|---|---|---|

| 处理方式 | 词级映射 | 上下文驱动 |

| 输出风格 | 单一标准 | 可调语气(正式/口语/学术) |

| 交互能力 | 需离线重训 | 即时对话式修正 |

| 多模态支持 | 文本为主 | 图片、语音、视频一体化 |

| 准确率 | 70%-75% | 90%-95% |

一句话总结:传统NMT是“词典式翻译”,LLM Translation是“智能对话式翻译”。

六、代码示例:用LLM实现AI助手翻译功能

使用OpenAI API调用LLM翻译(极简示例) import openai def llm_translate(text: str, target_lang: str, style: str = "formal") -> str: """基于大语言模型的翻译函数""" prompt = f""" 请将以下文本翻译成{target_lang},使用{style}风格: "{text}" 只输出译文,不要添加额外说明。 """ response = openai.ChatCompletion.create( model="gpt-4", messages=[ {"role": "system", "content": "你是专业的翻译助手。"}, {"role": "user", "content": prompt} ], temperature=0.3 ) return response.choices[0].message.content 测试对比 text = "This project is a game-changer for the industry." 传统风格(不可调) print("传统翻译:", "这个项目是行业的游戏改变者") 生硬直译 LLM翻译(可调风格) print("商务正式:", llm_translate(text, "中文", "formal")) 输出:“该项目将对行业格局产生颠覆性影响。” print("口语风格:", llm_translate(text, "中文", "casual")) 输出:“这个项目可太牛了,直接改写行业玩法。”

关键要点:

temperature=0.3保持翻译稳定性,避免过度发散通过

system角色设定专业翻译身份style参数实现输出风格可控——这是LLM翻译区别于传统NMT的核心差异点-37

七、底层原理与技术支撑

LLM翻译能力的底层依赖三大技术基石:

7.1 海量多语言预训练

大模型通过在海量多语言语料上进行预训练,掌握了跨语言的语法、语义及文化常识。例如,Google TranslateGemma基于Gemma 3架构,支持55种语言互译-8;Meta的OMT模型更将支持范围扩展至1600种语言-32。

7.2 Transformer与自注意力机制

这是实现“全局上下文理解”的核心技术。Transformer的编码器将源语言转换为语义向量,自注意力机制让模型能够全面理解句子结构-。

7.3 微调与对齐技术

以Google TranslateGemma为例,采用双阶段微调:第一阶段使用人工高质量语料进行监督式微调(SFT);第二阶段引入强化学习,通过MetricX-QE等评估指标优化译文自然度-9。

💡 进阶提示:深入理解这些原理需要掌握“注意力机制矩阵运算”“Transformer的编码器-解码器结构”等底层知识,这些内容将在后续系列文章中详细讲解,本文不再深入展开。

八、高频面试题与参考答案

Q1:大语言模型翻译与传统神经机器翻译(NMT)的核心区别是什么?

参考答案:核心区别在于“处理范式”的差异。传统NMT采用“编码器-解码器”架构,基于词级映射完成翻译;而LLM Translation基于大语言模型的预训练能力,实现“上下文驱动的语义理解”。具体体现在三个方面:①LLM可通过提示词灵活调整译文风格,传统NMT输出单一;②LLM支持交互式迭代修正,传统NMT需离线重训;③LLM在多语言、多模态任务中表现更优。

Q2:请简要说明Transformer中的自注意力机制如何提升翻译质量?

参考答案:自注意力机制通过计算句子中每个词与其他所有词的关联权重,使模型能够动态捕捉全局语义依赖。以“The cat sat on the mat because it was tired”为例,自注意力机制帮助模型正确判断“it”指代“cat”而非“mat”,从而生成准确的指代翻译。这一机制解决了传统RNN处理长距离依赖时的信息衰减问题。

Q3:在实际开发中如何评估AI助手翻译功能的质量?

参考答案:主要从四个维度评估:①BLEU值(衡量译文与参考译文的n-gram重合度),通用领域可达0.45以上;②准确率(语义传达正确性),LLM翻译可达90%-95%;③延迟(实时翻译场景需控制在500毫秒以内);④风格一致性(专业术语的跨文档统一性)。

Q4:LLM翻译目前存在哪些局限性?

参考答案:①推理成本较高,大规模商用需考虑成本效益;②长文本处理易丢失上下文,需配合分段策略;③对低资源语言(如斯瓦希里语等小语种)支持不足,翻译质量下降约40%-1;④文化隐喻处理仍有偏差,需人工审核介入-3。

Q5:人机协同翻译模式中,AI和人类各自扮演什么角色?

参考答案:AI负责基础信息处理与专业术语匹配,准确率可达96%;人类负责语境优化与情感传递-39。AI将译者从重复性任务中解放,使其聚焦于高价值环节-38。

九、结尾总结

9.1 核心知识点回顾

本文围绕AI助手翻译功能,系统讲解了以下内容:

痛点:传统NMT缺乏上下文理解、输出单一、无法交互

核心概念:LLM Translation——基于大语言模型的上下文驱动翻译

关联技术:Transformer架构与自注意力机制——全局语义建模的基础

代码示例:用LLM实现风格可控的智能翻译

底层支撑:预训练 + Transformer + 微调对齐

面试考点:对比差异、自注意力原理、评估指标、局限性分析

9.2 易错点提示

❌ 误区1:认为LLM翻译就是“更大参数的NMT”——实际上二者处理范式完全不同

❌ 误区2:盲目相信AI翻译100%准确——低资源语言和文化隐喻仍需人工审核

✅ 正确认知:AI处理70%标准化内容,人工聚焦30%高价值优化,这才是最高效的工作流

9.3 下篇预告

下一篇我们将深入Transformer的底层实现,讲解自注意力机制的矩阵运算细节与位置编码的数学原理,帮助读者从“会用模型”进阶到“理解模型”。敬请期待!

📌 本文参考资料:包括百度AI同传技术解析(2026.04)、讯飞开放平台技术文章、澎湃新闻行业报道、Slator行业分析等,数据截止2026年4月。