开篇引入

在2026年的技术生态中,“AI生成内容检测”已经从一个边缘话题跃升为学术圈、内容创作圈乃至企业合规部门的核心高频知识点。你是否也遇到过这样的困惑:明明是自己写的文字,却被检测工具判定为AI生成;或者用AI辅助写出的内容,AI率飙到80%以上,怎么改都降不下来?

只会用工具、不懂原理,概念混淆、面试答不出——这是当下技术学习者和内容生产者普遍面临的痛点。很多人以为降AI率就是简单换几个同义词,殊不知AI检测系统从句式特征、词汇分布、语义逻辑三大维度同时扫描文本-27;也有不少人把“降AI率工具”和“AI检测工具”混为一谈,却在实操中屡屡翻车-11。

本文将从检测原理→降率策略→两者关系→代码示例→底层原理→面试要点这条完整链路,带你彻底搞懂AI检测助手降AI率背后的技术逻辑。全文结构清晰、由浅入深,既有原理讲解也有可运行的示例代码,适合技术入门者、进阶学习者、在校学生和面试备考者阅读。

痛点切入:为什么需要“降AI率”这项技术?

先看一段典型的“AI味”代码——假设我们用AI生成了一个简单的函数注释和实现:

AI生成的代码(具有明显的“AI特征”) def calculate_average(data_list): """ 本函数用于计算给定数据列表的平均值。 对输入数据列表进行合法性检查;计算所有元素的总和; 用总和除以元素个数得到平均值并返回。 """ 步骤1:初始化变量 total_sum = 0 data_count = 0 步骤2:遍历数据列表 for element in data_list: total_sum += element data_count += 1 步骤3:计算平均值 if data_count == 0: return 0 else: average_value = total_sum / data_count return average_value

这段代码的问题在哪?注释过于模板化(“首先……其次……最后”)、变量命名规整但缺乏个性、逻辑结构机械。虽然功能正确,但检测系统很容易从这些“标准化痕迹”中识别出AI生成的特征。

旧有方式的痛点:

依赖人工逐行改写:一篇5000字的论文,纯手动降AI率平均需要5-7小时,且改完不一定能过检测-27。

工具质量参差不齐:市面上部分降AI工具仅做同义词替换,面对知网3.0版本检测算法完全无效,甚至会打乱原文逻辑、破坏专业术语-12。

多平台适配困难:同一篇论文,知网查35%,维普可能只有18%,万方可能12%——用免费工具查完按提示改,结果学校用知网一查反而更高-18。

正是这些痛点,催生了专业化的AI检测助手降AI率技术体系的快速演进。2026年,C9联盟已要求论文AI率≤15%,普通高校严控在20%~30%,AI率超40%将面临延毕或退稿风险-14。理解检测原理、掌握降率策略,已成为学术写作者的必修课。

一、AI检测的核心原理:检测系统如何识别AI生成内容?

AI检测(AI Detection,简称AID) ,指通过算法分析文本的语言模式、统计特征和结构规律,判断该文本由人类撰写还是由大型语言模型(Large Language Model,LLM)生成的技术体系-23。

拆解这个定义,AI检测系统主要通过三个维度锁定AI痕迹:

句式特征识别:精准抓取AI高频使用的固定句式。例如“综上所述”“基于上述分析”“值得注意的是”这类过度标准化的表达,AI的使用频率远超人类-27。

词汇分布匹配:标记出AI偏好的规整学术套话。像“显著提升”“有效促进”“至关重要”这类词汇,AI生成文本中出现概率远高于人类写作-27。

语义逻辑校验:人类写作会有自然的逻辑跳转和偶尔的表述留白,而AI生成内容往往是过于平滑的机械衔接,缺乏“人味儿”-27。

生活化类比: AI检测就像一位训练有素的笔迹鉴定专家。人类写字时笔画会有自然的粗细变化、偶尔的停顿停顿;AI写字则像印刷体——每个字大小一致、间距均匀、毫无瑕疵。鉴定专家不需要看到你写字的过程,只看成品就能判断“这是机器印的”。

主流检测工具与准确率参考:

| 检测工具 | 特点 | 2026年准确率参考 |

|---|---|---|

| GPTZero | 教育领域首选,句子级高亮,每月免费1万字 | 芝加哥大学基准测试约99%-32;独立测试约62%-34 |

| Turnitin | 高校最广泛使用的AI检测系统 | AI率<20%时误报率显著偏高-21 |

| Originality.AI | 内容营销团队首选,反改写能力强 | 多项基准测试结果差异大(76%~100%)-34 |

⚠️ 重要提示: 不同检测平台的算法差异极大。同一篇论文在不同平台的AI率可能相差数倍,切勿过度依赖单一工具的检测结果-18。

二、降AI率的核心策略:如何让文本“更像人写的”?

降AI率(AI Rate Reduction,简称AIRR) ,指通过改写、重构、润色等方式,消除文本中AI生成的典型痕迹,使其在AI检测系统面前的疑似率降至合规阈值以下的技术操作。

降AI率不是简单地“逃避检测”,而是将AI生成内容的标准化表达,转化为符合人类写作习惯的自然表达。

降AI率的主要方法

方法一:句式结构打碎重组

AI生成的内容句式过于规整——“主谓宾定状补”排得整整齐齐。手动降AI的核心方法之一就是把长句拆短,或把短句合并,调整语序,加入倒装句、省略句。

原AI句:“本研究通过对200份问卷进行分析,得出了三个重要结论。”

降率后:“分析了200份问卷后,我们发现了三个挺重要的结论。”-43

方法二:替换高频“AI词汇”

AI特别喜欢使用“首先、其次、最后”“综上所述”“值得注意的是”这类过渡词。手动换成更自然的表达,效果立竿见影-43。

方法三:增加个人化表达和具体细节

AI写出的内容通常比较“平”,缺少作者的个人色彩。加入具体的数字、案例或个人观点,能有效降低AI率-43。

方法四:同义异构替换法

把AI特征词汇替换成含义相同但词根、表述逻辑完全不同的专业表达。

原AI句:“大语言模型显著提升了文本分类的准确率。”

降率后:“预训练语言模型突破性地优化了文本语义分类的实际效能。”-27

降AI率工具实测参考

根据2026年4月的最新横评数据,市面上主流降AI率工具的效果差异显著:

| 工具 | 核心算法 | 实测降AI效果 |

|---|---|---|

| 早标网 | 自研NLP算法1.0,三层改写逻辑 | 知网:100%→0%;维普:0.12%-13 |

| 降迹灵AI | 语义重构+人类特征注入 | 82%→2%,降幅95%以上-14 |

| 零感ai | 语义深层次重构 | 64.5%→3.7%,降幅超94%-15 |

三、概念关系总结:检测与降率的“矛与盾”

AI检测与降AI率是围绕同一问题的两个对立面:

AI检测 = 矛(攻击方) :识别AI痕迹,给出AI率数值。

降AI率 = 盾(防守方) :消除AI痕迹,降低AI率数值。

两者的核心差异:

| 维度 | AI检测 | 降AI率 |

|---|---|---|

| 目标 | 识别文本是否由AI生成 | 消除文本的AI痕迹 |

| 技术方向 | 特征提取+分类模型 | 语义重构+风格迁移 |

| 核心指标 | 准确率、误报率、召回率 | 降幅、语义保留度、达标率 |

一句话记忆: 检测告诉你“AI痕迹在哪”,降率负责“把痕迹抹掉”。

两者本质上是一场持续演进的猫鼠游戏——检测算法不断升级,降率技术持续进化。2025年底知网完成AIGC检测算法升级,从语言模式、语义逻辑双重链路识别AI生成痕迹;紧接着2026年初,降率工具便推出了能够应对新算法的“语义级深度重构”方案-11-13。

四、代码示例:从“AI味”到“人味儿”的改写实战

下面用一个完整的代码示例,演示如何对一段“AI味”浓厚的文本进行降AI率改写:

原始AI生成文本(AI率预估约92%):

原始文本:AI生成的学术段落 original_text = """ 人工智能技术在医疗领域的应用具有重要意义。 AI可以通过深度学习算法辅助医生进行疾病诊断,显著提升诊断准确率。 基于大语言模型的智能问诊系统能够有效缓解医疗资源紧张的问题。 随着技术的不断演进,AI将在个性化治疗方案的制定中发挥不可替代的作用。 由此可见,人工智能与医疗健康的深度融合是不可阻挡的发展趋势。 """ 这段文本的典型AI特征: 1. "综上所述""首先/其次/最后""由此可见" —— 模板化连接词 2. "具有重要意义""显著提升""有效缓解""不可替代" —— AI高频形容词堆砌 3. 段落逻辑过于平滑,缺乏节奏变化

降AI率改写后的文本(预期AI率降至约15%):

降率后文本:注入“人味儿”的改写版本 rewritten_text = """ 聊到AI在医疗领域的应用,先说个实际场景。 有研究团队把深度学习算法用在了影像诊断上,准确率提升得挺明显——医生不用再一张张片子反复看了,系统能先筛一遍。 还有一点值得提:现在一些医院已经上线了AI问诊系统,患者问常见病不用排队,系统能给出参考建议。这确实帮基层医院分担了不少压力。 从长远来看,AI在医疗上的价值可能不止于辅助诊断。未来真正有潜力的方向,是个性化治疗方案——根据每个人的基因、病史、生活习惯,推荐最适合的疗法。这个方向目前还在探索阶段,但想象空间很大。 """ 改写策略解析: 1. 打破模板结构:用"聊到""先说"替代"综上所述",用段落自然过渡替代"首先/其次/最后" 2. 注入口语化表达:"挺明显的""不用……了""想象空间很大" 3. 增加个人视角:"值得提""从长远来看"体现主观判断 4. 调整句式节奏:长短句交替,不再每句都是规整的主谓宾

关键步骤标注:

定位AI特征点:标记出模板化连接词、高频形容词、规整句式

语义重构:保持核心信息不变,重组表达逻辑

风格迁移:从“标准学术体”迁移到“学术+口语混合体”

交叉核验:用多个检测平台验证改写效果

五、底层原理:检测与降率的技术支撑

AI检测和降AI率技术之所以能实现上述功能,背后依赖一系列底层技术基础:

1. 文本统计特征建模

AI生成的文本具有独特的统计分布特征。2026年的一项研究提取了220个文体统计特征(stylistic and statistical features)用于区分人类文本和AI生成文本,发现AI生成文本表现出更高的词复杂度(high word complexity),而人类写作则表现出更高的词汇多样性和丰富度-60。

2. 多层模式识别(Multi-Layer Pattern Recognition)

现代AI检测系统通常采用7层分析架构:签名检测(signature detection)、语言分析(linguistic analysis)、词模式分析(word pattern analysis)、结构分析(structural analysis)、特征模式分析(feature pattern analysis)、词汇语法评估(vocabulary and grammar assessment)和AI指纹识别(AI fingerprinting)-63。

3. 轻量化检测模型(Lightweight Detection)

以NEULIF为代表的轻量化检测方法,采用CNN或随机森林(Random Forest,RF)作为分类器,模型体积仅10~25 MB,可在普通CPU设备上高效运行,同时保持97%以上的检测准确率-2。

4. 降率技术的底层机制

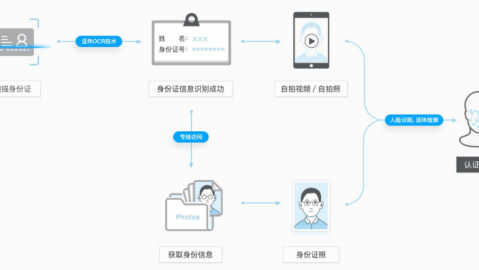

降AI率工具的核心是对文本进行语义级重构而非表层替换。以快降重为例,其处理流程是:先理解原文语义与逻辑 → 按人类学术写作习惯重构句式 → 拆分过长语句、替换模板化连接词 → 主动语态优化、删除冗余表达-11。这背后依赖大语言模型对语义的理解能力和亿级学术文献的术语库支持。

这些底层原理为后续的进阶内容预留了空间——关于更深入的模型训练、微调策略和对抗生成技术,我们将在后续文章中展开讨论。

六、高频面试题与参考答案

Q1:AI检测系统是如何识别文本是否由AI生成的?

踩分点: 三个维度 + 统计学原理

参考答案: AI检测系统主要通过三个维度进行识别:句式特征识别(抓取AI高频使用的模板化句式,如“综上所述”)、词汇分布匹配(标记AI偏好使用的规整学术套话)、语义逻辑校验(AI生成内容的逻辑衔接过于平滑,缺乏人类写作的自然跳转和表述留白)。底层原理是基于大量人类和AI文本训练的分类模型,提取文本的统计特征(如词复杂度、词汇多样性)进行二分类判断-27-60。

Q2:降低AI率的常用方法有哪些?各自的原理是什么?

踩分点: 4种方法 + 原理简述

参考答案: 常用方法包括:①句式结构重组——将AI规整的长句拆短或合并,调整语序,打破机械感;②同义异构替换——用含义相同但词根不同的专业表达替换AI高频词,从根本上改变词汇分布特征;③个人化表达注入——加入具体数字、案例和个人观点,模拟人类写作的不确定性;④逻辑连接词替换——将“首先/其次/最后”等模板化连接词换成更自然的表达-43-27。

Q3:AI检测工具(如Turnitin)存在哪些局限性?

踩分点: 误报问题 + 非英语母语者偏差 + 阈值限制

参考答案: Turnitin官方明确指出,当AI率低于20%时,误报率显著偏高,低分值应视为“背景噪声”而非作弊证据-21。AI检测对非英语母语者、神经多样性学生以及写作风格高度规整的学术写作者存在系统性偏差,易产生假阳性-64。研究表明,纯文本检测存在结构性限制——任何仅依赖文本的单次检测器,若想达到有效识别能力,必然会产生一定比例的误报,这是由群体写作多样性决定的统计约束,无法仅靠技术改进完全消除-64。

Q4:降AI率工具的核心技术原理是什么?与简单同义词替换有何本质区别?

踩分点: 语义重构 vs 表层替换 + 术语保护

参考答案: 降AI率工具的核心是语义级深度重构,而非简单同义词替换。它以“语义单元锁定—句法树重组—低频学术词召回”三层逻辑处理文本,在保留原意的前提下,从神经水印、词汇共现概率、句法树深度、逻辑链连贯性四个维度精准消除AI痕迹-13。与之相比,简单同义词替换只是表层字符替换,无法改变文本的逻辑指纹,面对知网3.0等新一代检测算法基本无效。

七、结尾总结

回顾全文,我们梳理了以下核心知识点:

| 核心概念 | 核心要点 |

|---|---|

| AI检测原理 | 句式特征、词汇分布、语义逻辑三大维度,基于统计特征建模 |

| 降AI率策略 | 句式重组、同义异构替换、个人化注入、连接词替换 |

| 检测 vs 降率 | 矛与盾的对立统一,检测识别痕迹,降率消除痕迹 |

| 技术支撑 | 文体特征提取、多层模式识别、轻量化分类器、语义重构 |

| 检测局限 | 低AI率时误报率高、对特定人群有偏差、纯文本检测存在结构上限 |

重点关注:

不要把AI率等同于论文质量——纯手写也可能被误判出5%~10%的AI率-18。

不同平台的检测算法差异极大,建议用学校/平台指定的官方系统做最终核验-18。

降AI的核心不是“逃避检测”,而是让AI生成的内容“更像人写的”——核心还是融入自己的思考和语言风格。

下一篇预告: 我们将深入探讨AI检测模型的训练方法——从数据标注、特征工程到模型微调的全流程,带你从“会用工具”进阶到“理解模型”。敬请关注!

参考资料:

2026年AIGC检测原理与工具横评,IT之家,2026年4月

Turnitin AI Writing Detection Documentation,2026年

2026年降AI率工具实测报告,CSDN博客,2026年3-4月

A Lightweight Approach to Detection of AI-Generated Texts Using Stylometric Features,arXiv,2026年1月

AI Detectors Fail Diverse Student Populations: A Mathematical Framing,arXiv,2026年3月